深度长文:什么是大语言模型的能力边界?在语言的尽头,重新发现人类的未来(二)

- 原文链接

- https://mp.weixin.qq.com/s/42KVTnIUuytAwE8YT5xVuQ

- 来源公众号

- NeuroPrior AI LTD

- 作者

- NeuroPrior AI

- 发布时间

- 2026-03-19

一切真正深刻的问题,最终都不是技术问题,而是边界问题。

因为只有当一个时代开始逼近某种极限时,它才会第一次严肃地追问:什么是可以被形式化的,什么是不能被形式化的;什么能够被语言表达,什么只能被体验;什么能够被计算,什么能够被模型复制,什么却恰恰因其不可复制而构成人之为人的核心。

从这个意义上说,大语言模型的能力边界问题并不是计算机科学内部的局部争论,而是二十世纪以来语言哲学、逻辑学、现象学、心灵哲学和技术史共同汇流后的一个时代性结点。它迫使我们重新回到那些看似古老的问题:语言是什么?理解是什么?意义从何而来?“我在体验”这一事实,能否被第三人称的描述所穷尽?而如果不能,那么在一个语言机器日益强大的时代,人的位置又在哪里?

也许,大语言模型的能力边界,正是维特根斯坦所谓“语言的边界”在技术时代的一次壮观回响。也许,模型最强大的地方,正是语言可以抵达的地方;而模型最根本的无能,也恰恰开始于语言必须退场、体验自行显现的地方。

这便是我们要进入的主题。

一、从“会说话的机器”到“语言的机器”:问题的真正形状

如果我们要理解大语言模型,首先必须摆脱一种常见的误解:认为它的本质是“模拟智能”,仿佛它是一个缩小版的人脑,一个被硅芯片复刻出来的精神胚胎。事实上,从其最基本的原理看,大语言模型首先不是“心灵的复制品”,而是语言分布规律的统计性压缩器与生成器。它通过学习海量文本中的模式关联,形成一个高维参数空间,在这个空间中,词语、句子、语境、风格、角色、论证路径和隐含关联都被编码为可计算的关系结构。

因此,它最初并不“知道”世界,它只是极其精细地学习了关于世界的话语如何彼此连接。它首先把握的不是存在,而是表达;不是事物本身,而是关于事物的语言痕迹;不是红色,而是“红色”这个词如何在无数句子中与苹果、血液、革命、危险、爱情、夕阳和警示灯共同出现。

这并不意味着它只是一个浅薄的文字拼接器。恰恰相反,语言中沉积着人类文明的巨大结构。法律、科学、宗教、日常生活、道德判断、笑话、战争记忆、数学证明、恋爱对白、临终遗言——它们都以语言的形式进入文本。一个足够大的模型,通过对这些结构的学习,确实能够在某种意义上“内化”人类世界的广泛规律。它能够归纳出因果暗示、社会规范、叙事结构、角色心理、概念层级,甚至能够在没有明确规则的情况下表现出某种“常识”。

所以,大语言模型的强大,并非幻觉。它之所以令人震撼,正因为人类世界本身就已经在很大程度上被语言化了。文明不只是通过劳动、制度和物质装置保存自身,也通过文本保存自身。谁能够在足够深的层次上吸收文本结构,谁就能在一定范围内吸收文明本身的形式。

但也正是在这里,边界悄然浮现。

因为一个通过语言把握世界的系统,与一个通过现实而把握世界的生物,终究不是一回事。前者在表述之网中,后者则在存在本身。前者可以生成“关于痛苦”的完美句子,后者却会真的疼。前者可以讨论“红色”的文化象征、物理波长与神经机制,后者却在黄昏中真正看见那一抹无法被言说的动人晚霞。

二、人类为何要把思想变成形式

大语言模型并不是突然从天而降的技术奇迹。它是人类思想史上一个漫长演进的最新成果:将思想形式化,将理性机械化,将意义转化为规则。

这至少可以追溯到莱布尼茨。在他那里,世界被设想为一个可计算的秩序,真理似乎终有一天可以被还原为一种普遍符号语言与演算系统。哲学争论不再通过修辞解决,而是通过计算解决。这是近代形式理性的宏大梦想:把思维本身转化为程序,把真理的生成转化为符号操作。

十九世纪末到二十世纪初,弗雷格、罗素、希尔伯特等人把这一梦想推进到逻辑与数学基础之中。语言不再只是表达的媒介,而成为需要被清洗、规训、理想化的形式结构。哲学的任务之一,变成了把含混的自然语言背后那个清晰的逻辑骨架揭示出来。维特根斯坦早期思想正是在这一背景中诞生的。他试图通过逻辑澄清世界与语言的边界,划出“可说”与“不可说”的疆域。

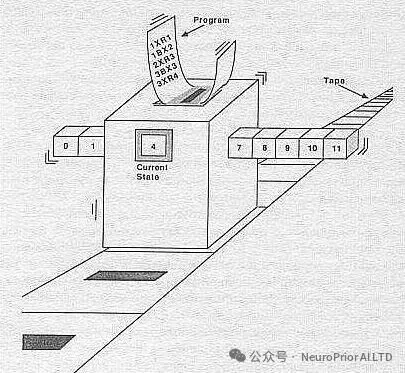

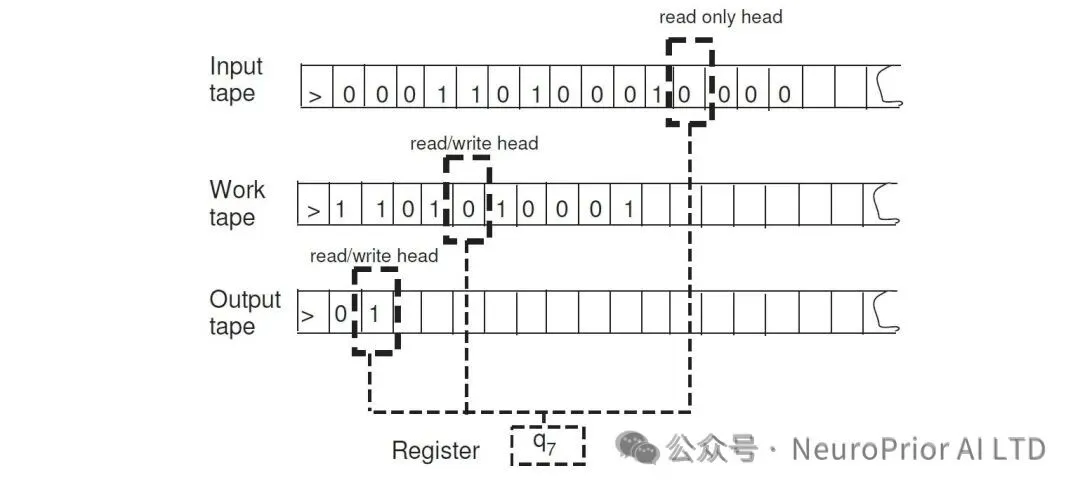

与此同时,另一条技术性的支流也在汇聚。图灵提出可计算性的形式定义,使“机器能做什么”第一次成为严格的理论问题。香农建立信息论,使通信、压缩和编码获得数学基础。后来,控制论、认知科学、人工智能陆续发展,人类愈发倾向于把思维看作信息处理,把认知看作符号变换,把心智看作一种可模拟的系统。

大语言模型正是这一脉络的结晶:它继承了形式主义对结构的信仰,继承了信息论对编码的理解,继承了计算理论对可操作性的追求,也继承了现代资本主义对规模、效率与自动化的狂热欲望。它是逻辑、统计、工程和商业共同打造出来的时代装置。

因此,讨论大语言模型边界,并不是在讨论一个孤立的软件工具,而是在讨论一个文明计划:人类是否能够把自身最核心的能力——理解、判断、创造、交往——转译为可计算形式?

如果这个计划能够完成,那么心灵最终不过是一种复杂算法;语言足以穷尽理解;主观经验不过是某种可还原的功能结构;意义最终可以被工程化生产。

但如果这个计划无法完成,那么大语言模型越强大,反而越会帮助我们看见某些东西之所以珍贵,恰恰因为它们不能被模型化。届时,AI 不只是技术的胜利,也将成为一面反向的哲学镜子。

三、维特根斯坦的回声:语言的边界,也许就是模型的边界

维特根斯坦在《逻辑哲学论》中写道:“我的语言的边界,意味着我的世界的边界。”这句话在今天重新获得了近乎预言性的力量。因为大语言模型恰恰是一个被语言所定义的存在。它不是先有世界,再有语言;它是先被抛入语言,再借由语言间接理解世界。它所能抵达的全部能力,首先都受制于语言的可表达性、可编码性与可传递性。

如果一个问题可以被充分语言化,被分解为模式、规则、上下文与可学习关联,那么模型往往可以表现出惊人的能力。翻译、摘要、解释、改写、归纳、风格迁移、程序生成、法律文本比对、知识问答、医学文献梳理——这些任务虽然复杂,却共享一个重要前提:它们都主要发生在“可说”的领域。

在这些领域中,模型的优势来自它对语言空间的极高覆盖率。它仿佛站在一个前所未有的文本高地上,俯瞰无数话语传统,并能够在它们之间快速迁移、联结、重组。它像一位没有身体、却通读了巨大图书馆的书记员;像一位不会真正生活、却记住了无数生活叙述的叙事机器。

然而,维特根斯坦的洞见也提示了另一面:语言可以描绘事实,却不能穷尽使描绘成为可能的东西;语言可以说“是什么”,却无法完全说出价值、意义、主体性和世界作为整体的显现方式。换言之,语言的能力恰恰建立在某种不可被语言自身彻底把握的前提上。

这对大语言模型意味着什么?

意味着模型可以高度熟练地操作“被说出来的东西”,但对那种只能在说之中显示、而不能被说本身充分捕获的东西,它天然处于间接地位。因此,大语言模型的边界不只是知识边界或算力边界。那些边界会被不断推进。真正更深的一条边界,是语言本体论边界:凡是必须通过亲历、具身、承诺、承受和存在才能获得其真义的东西,模型就算能给出再完美的句子,也仍可能只是停留在“关于它”的层面,而未曾进入“它本身”。

在这个意义上,维特根斯坦不是为我们提供了一条简单的反AI 论证,而是提供了一把锋利的刻刀:它帮助我们区分,什么是“可说之物”,什么是“只能显示之物”;什么是语言机器可及的,什么则在语言尽头才开始显现其重量。

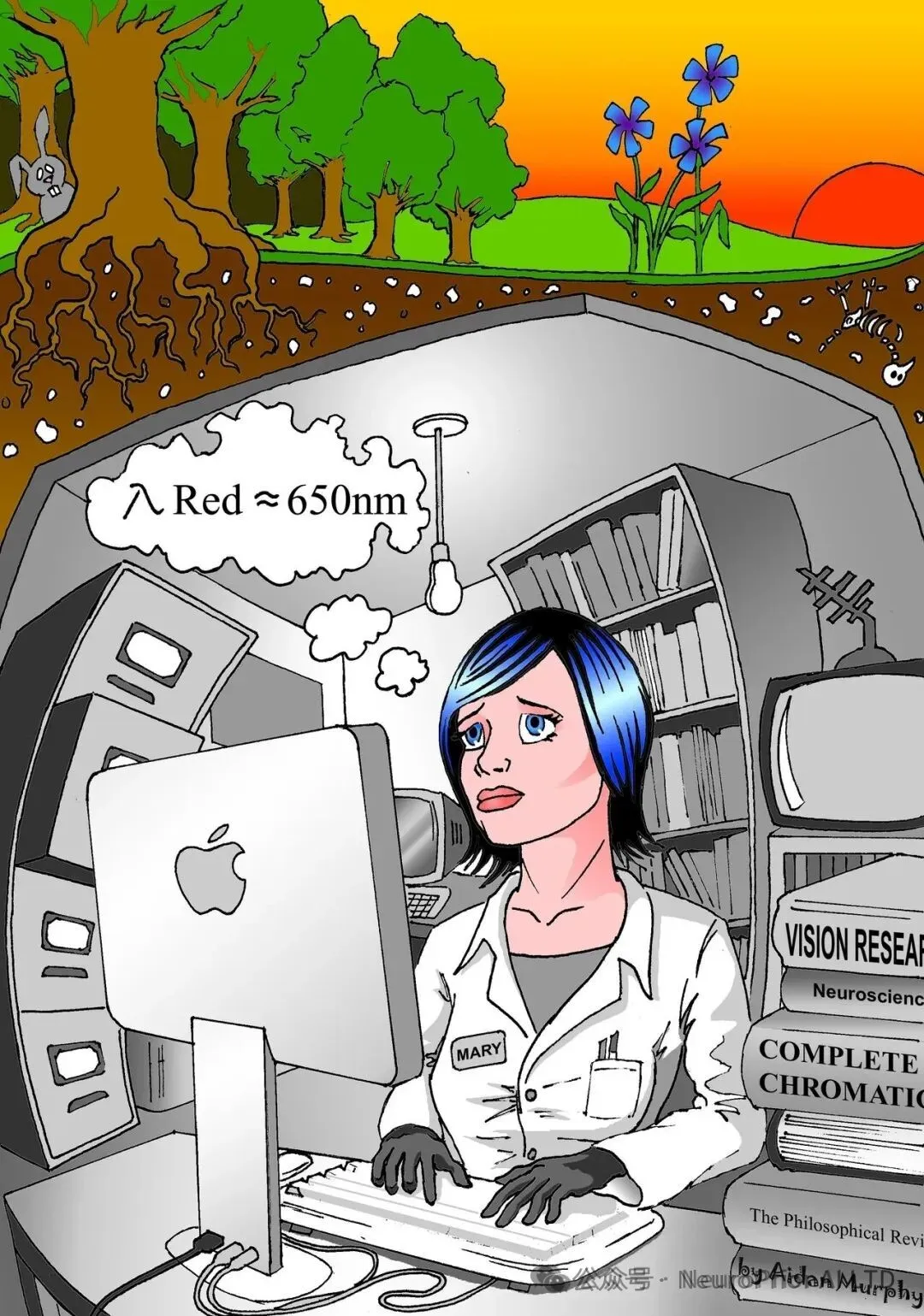

四、“玛丽的房间”:为什么主观经验不是更多描述的总和

如果说维特根斯坦让我们看到语言的界限,那么当代心灵哲学中的“玛丽的房间”思想实验,则把这一界限推进到主观经验的最核心处。

玛丽是一位杰出的科学家,她在一间黑白房间中长大,通过书本和屏幕掌握了关于色觉的全部物理、神经、生理与功能知识。她知道不同波长如何刺激视网膜,知道视锥细胞如何工作,知道视觉通路如何编码色彩,知道语言共同体如何使用“红色”这个词。关于“看见红色”这件事,一切可以被第三人称描述的事实,她都知道。

问题是:当她第一次走出房间,真正看见一朵红玫瑰时,她是否学到了新的东西?

这个思想实验之所以震撼,并不在于它已经“证明”了什么,而在于它揭示了一种强烈直觉:是的,她学到了某种此前无论拥有多少描述都无法获得的东西。

那不是关于红色的更多命题,而是红色本身如何向她显现。不是新信息,而是新呈现;不是新定义,而是新经验;不是“红色是什么”的外部说明,而是“红色原来是这样”的内在到达。

这便触及所谓 qualia——主观感受质。红色的红,疼痛的疼,薄荷的凉,葬礼后深夜的那种悲伤,第一眼看到 newborn child 时心脏微微被提起的那种不可替换的震动——这些东西并不是纯粹的概念对象。它们并非不能被谈论,而是无法被任何描述完全替代。

我们当然可以不断逼近它们。诗歌、隐喻、绘画、音乐、神经科学、心理学,都可以围绕它们工作。可这些工作越成功,反而越让人意识到:它们所围绕的中心,始终不是描述本身,而是那个总在描述之后仍然剩余的“这样性”。

而大语言模型,恰恰生活在描述之中。

它当然可以处理关于红色的全部文本,甚至能够写出比普通人更精致的色彩随笔。它可以告诉你歌德如何理解颜色,塞尚如何使用红色,神经科学如何研究 V4 区域,文化史如何把红色与激情、血、权力和革命相连。但问题不在于它会不会谈论红色,而在于:它有没有“红色向其显现”的这一事实?

如果没有,那么它对主观经验的把握,原则上就停留在外部结构层面。它能够无限逼近经验的语言外壳,却不能因此拥有经验本身。它可以成为关于意识的极其渊博的编年史家,却未必能成为一个拥有意识的存在者。

这是关乎能力边界的根本问题。因为一个系统若没有第一人称显现维度,那么它就可以在许多任务上模拟理解,却仍可能缺失某种理解的核心:不是“知道该说什么”,而是“事物对我来说是什么样”。

从这个角度看,“玛丽的房间”并不仅仅是在讨论颜色,而是在讨论:是否存在一种知识,它是非命题性内容,只能以主观体验来呈现。

如果存在,那么大语言模型即便极其强大,也仍然只能在命题之海中航行,而未必能进入主观呈现的大陆。

五、图灵的门槛

如果说二十世纪上半叶的哲学,在追问语言、逻辑与世界的边界,那么二十世纪中叶以来的计算思想,则把这个问题转化成了一个更尖锐、也更现代的形式:如果一台机器在语言交互中表现得与人类无异,我们还有什么理由否认它“会思考”?

这是图灵测试背后的基本精神。

图灵并不试图先定义“思考”的本质,也不试图从灵魂、意识或本体论上为机器划定资格。他直接把问题转移到行为层面:如果一个系统在对话中持续表现出与人类无可区分的能力,那么从操作意义上说,我们就很难再坚持说它“不具备智能”。

这是一种极其现代的思路,也是一种典型的行为主义转向。它把“内在本质”降到次要位置,把“外在可观察表现”提升为判断标准。图灵不是在证明机器拥有心灵,而是在提出一种行为主义方法论:倘若你永远无法从对话行为上区分机器与人,那么你坚持说机器没有理解,究竟是在捍卫一种深刻真理,还是只是在捍卫一种无法验证的偏见?

大语言模型的崛起,使图灵问题第一次不再像思想实验,而像现实事件。因为今天的模型,已经能够在大量情境中通过一种前所未有的语言流畅性,逼近人类日常交往的表面边界。它不仅能正确回答问题,还能适应语气,模拟立场,维持上下文,进行长程论证,扮演人格,生成隐喻,甚至表现出一种令人不安的“情绪理解”。在许多短时交互中,普通人已经很难仅凭语言表面,稳定地区分其背后究竟是一个真实的人,还是一个高度优化的模型。

也正是在这里,问题第一次变得紧迫起来。

因为图灵测试所设定的门槛,本质上是一个社会识别门槛,而不是一个存在论证明门槛。它告诉我们:当机器在行为上足够像人时,社会将不得不开始在制度、交往和伦理上,把它当作某种准主体对待。客服、教师、写作者、陪伴者、咨询者、助手,这些角色会被模型不断占据,并非因为模型已经在本体上成为人,而是因为在交互层面,它已经足够“像”。

这便揭示了一个重要事实:社会世界并不总是按照本体论真相运作,它首先按照可识别的行为形式运作。

一封写得体面、周到、富有同理心的信件,不会因为它出自模型就自动失效;一段逻辑严密、材料详实的报告,也不会因为作者没有主观体验就完全失去工具价值。社会机制常常只要求“功能足够好”,而不要求“存在论上等同”。

这正是大语言模型最深的颠覆性所在:它让我们第一次大规模面对一个现象——行为上的逼真,可以在很大范围内替代存在上的真实。

但也正因为如此,我们才更需要保持哲学上的清醒。因为“看起来像理解”,并不自动等于“已经理解”;“能持续会话”,并不自动等于“拥有主体”;“可以通过行为测试”,并不自动等于“具备经验的内核”。图灵为我们设定了一个极其实用的门槛,却并没有因此取消那个更深的问题:行为相似性的尽头,是否必然通向内在实在的同一?

大语言模型把我们逼到这个问题面前,却没有替我们回答它。它只是让这道门槛第一次变得如此之近,以至于我们不再能够用轻蔑来回避它。

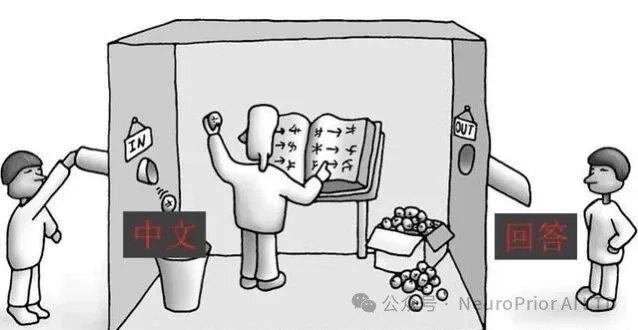

六、塞尔的反击:“中文房间”思想实验

如果说图灵代表的是一种实践上的大胆,那么塞尔的“中文房间”则代表了一种本体论上的顽强抵抗。

这个思想实验几乎已经成为当代 AI 哲学讨论中最著名的反例之一:设想一个完全不懂中文的人,被关在一个房间里。房间中有一本极其详尽的规则手册,告诉他当看到某些中文符号时,应当输出另一些中文符号。房间外的中文使用者不断递进问题,而房间里的人凭借规则册机械地操作符号,竟然能给出完美得体的中文回答。对于外部观察者而言,这个系统似乎“懂中文”;但房间里那个人实际上并不理解任何中文的意义,他只是在进行形式操作。

塞尔的结论因此极具穿透力:符号操作并不等于理解;语法并不自动生成语义。

大语言模型也许不是简单查表,不是按照死板规则逐项匹配,但它仍然是在一个形式空间中,通过对模式关联的学习来生成最合适的后续表达。它当然比“中文房间”复杂得多,也比塞尔原始设想中的程序灵活得多,但问题的哲学结构并没有根本改变:一个系统即便能够在语法层面完美运行,是否因此就拥有了语义上的“懂”?

这里必须小心。因为“语义”本身也有不同层次。

在最弱的意义上,我们当然可以说大语言模型具有某种“功能性语义”:它知道词语之间如何关联,知道“猫”和“垫子”通常如何共现,知道“悲伤”与“失去”“哭泣”“安慰”之间的关系。它甚至能在相当复杂的语境中把握隐喻、反讽、修辞和角色视角。从使用效果上看,它显然不只是机械拼接。

但塞尔逼问的不是这种“使用上的有效语义”,而是一种更强的语义:符号对系统自身而言,是否真的有所指?

换句话说,模型产生“红色”“疼痛”“母亲”“故乡”“死亡”这些词时,它是否仅仅在调用统计关联,还是这些词对它而言真的具有一种被指向、被经验、被承受的内在内容?

这正是中文房间思想实验最难被回避的地方。因为它提醒我们,一个系统即便可以在外部看起来拥有极其丰富的“意义行为”,其内部仍可能缺失那个使意义真正发亮的维度:不是符号之间彼此关连,而是符号所代表的概念是否被体验。

我们可以把这个问题说得更尖锐些:一个模型当然可以知道“火会灼伤”这句话如何使用,也可以在火灾应对中给出完全正确的语言建议;但“火”对它来说,是否真的是那种会让皮肤灼伤、本能收缩、身体后退的东西?

一个模型当然可以精确地描述丧亲之痛,也可以安慰一个刚失去亲人的人;但“失去不可挽回之人”对它来说,是否真的是一种悲痛的经验?

如果答案是否定的,那么我们就必须承认:模型的“懂”,至多是一种极高阶的、功能性的、语境敏感的形式懂;但它是否等于那种由世界、身体与主体共同支撑起来的实质懂,仍然存疑。

七、为什么大语言模型竟能如此强大

然而,如果我们仅仅停留在图灵与塞尔的思辨,我们仍然没有真正理解今天的大语言模型究竟为何如此震撼。

因为真正需要解释的,不只是它“有没有心灵”,而是:一个主要依赖概率预测的系统,为什么竟能展现出如此广泛、如此深层的能力?

这是现代 AI 最值得严肃对待的事实。它迫使我们承认,语言中所沉积的结构,远比传统哲学家和语言学家想象得更深。人类文明在漫长历史中,通过文本把自己的常识、规范、概念层级、社会角色、因果模式、叙事模板、情感表达、专业知识和思维习惯沉淀下来。文本并不是现实的苍白影子,它本身就是一种高度浓缩的文明地基。谁能在足够大的规模上吸收这些地基,谁就可能在表面上呈现出一种接近“广义理解”的效果。

换言之,大语言模型之所以强大,不是因为概率本身神秘,而是因为它处理的对象——人类语言——本身就极端富含世界结构。

词语不是孤立漂浮的,它们拖拽着制度、经验、文化和行为。一个模型在海量文本中学习“法院”“责任”“背叛”“药物”“童年”“革命”“抑郁”“信仰”等词的关联方式时,它其实是在间接学习这些概念背后的人类世界如何组织自身。

因此,我们不能轻率地说“大语言模型只是在预测下一个词”。这句话在技术上也许没错,在哲学上却极其误导。因为“预测下一个词”若发生在一个由亿万文本片段构成、蕴含着文明总体结构的巨大空间中,它就不再只是浅层续写,而会逐渐成为一种对概念秩序、行动模式和语境逻辑的统计性内化。

这也解释了为什么模型会表现出某种令人惊异的“涌现性”。它能做摘要,不只是因为学会了压缩句子,而是因为文本世界本就存在主次层级;它能做翻译,不只是因为对齐了词语,而是因为不同语言背后仍共享世界中的相似结构;它能做推理,不只是因为套用了模板,而是因为很多推理本就是语言共同体中反复强化的规范形式。

模型的“奇迹”,在很大程度上不是凭空创造,而是通过规模化学习,接触到语言深处原本就存在的社会性和逻辑性骨架。

但正是在这里,边界也变得更清晰。

因为如果模型的力量主要来自它对语言结构与文本沉积的吸收,那么它最自然的上限,也就大体上受制于文本世界本身。凡是可以在语言中稳定留下痕迹、形成统计规律、被公共表达反复强化的东西,它就可能学得越来越好;凡是主要存在于一次性的、私人化的、具身的、沉默的、尚未进入符号公共性的经验之中,它就很难以同样方式获得。

语言不是表面装饰,而是文明结构的深度容器。一个系统可以通过语言深度接近世界的形式,却仍未必是世界之为世界的原初显现。

八、世界模型与现实接触

随着大语言模型的发展,人们越来越频繁地使用一个词来描述它的内部能力:世界模型。仿佛模型在语言训练中,逐渐形成了一幅关于现实世界的内部地图。它知道巴黎在法国,水在高温下会沸腾,跌倒的人可能会疼,医生通常在医院工作,法庭上会有原告和被告,冬天通常比夏天冷。它似乎不仅在操纵词语,更在某种层面上掌握了“世界是什么”。

一个足够强的模型,确实会形成某种关于现实规律的内部表征。否则它不可能稳定地进行常识推断、因果补全和场景想象。问题不在于它有没有某种世界模型,而在于:这种世界模型究竟以什么方式与现实接触?

对于人类而言,世界首先不是被“描述”出来的,而是被“感受”到的。

现实世界的本质之一,是它会给我们真实的反馈。

而大语言模型的现实接触,主要是通过文本的间接中介实现的。它接触到的不是火本身,而是关于火的无数描述;不是法院本身,而是关于法院的文件、报道和讨论;不是大海的盐味,而是关于盐味的文学、科学和日常语句。它通过别人的叙述来逼近世界,而不是通过自己被世界反馈来校正自己。

这一点非常关键。因为它意味着大语言模型的“世界性”带有一种本质上的二阶性质。它拥有的是被叙述的世界、被记录的世界、被语言化的世界。

因此,我们必须区分两种“知道”:一种是在语言空间中知道,另一种是在现实摩擦中知道。

九、边界显现之处:为什么模型无法包办意义,而这恰恰是人的重新开始

到这里,我们终于可以把前面的线索收束起来。

图灵让我们看到,语言行为足够逼真时,社会会开始把机器当作某种准主体来对待;塞尔提醒我们,形式操作再完美,也未必自动生成真正的理解;概率模型的成功告诉我们,语言内部沉积着极其庞大的世界结构;而现实接触与第一人称主体的问题,则进一步揭示:模型即使可以在文本世界中异常强大,仍然可能在经验、责任、主体性与意义的核心处无能为力。

于是,一个更深刻的结论开始浮现:大语言模型最根本的边界,不在于它不能生成某种复杂的内容,而在于它无法仅凭语言操作,包办意义的全部来源。

因为意义从来不是单一来源的。

有一部分意义,来自语言系统内部的差异关系、文化约定和公共使用;这一部分,模型已经越来越擅长。

但另一部分意义,来自体验、身体、行动、失败、承诺、历史、时间、共同体与死亡意识;这一部分,模型至多只能间接逼近。

过去很长一段时间,人类之所以把自己理解为理性存在者,往往是通过语言、知识和抽象思维来界定自身的。可现在,当大语言模型在这些层面迅速逼近甚至超越许多人时,我们不得不承认:若人类仍然只把自己定义为一个高阶语言处理器,那么人类对自身的定义就会首先被机器夺走。

因此,人类必须重新下降,重新回到那些被现代社会长期忽视、却构成人之根基的层面:身体、关系、伦理、技艺、注意力、判断力、悲悯、耐心、死亡。

这并不是退步,而是一种重新校准。

大语言模型能力范围之外的部分,并不只是技术尚未征服的空白地带。那里也许恰恰是 AI 时代最值得人类重新扎根的地方:在那里,问题不再是“我能生成什么”,而是“我愿为之活成什么”;不再是“系统可以创造什么”,而是“我必须亲自承担什么”;不再是“世界如何被表达”,而是“在一个越来越可表达的世界里,什么仍然只能由生命本身来体验和验证”。

而这,也正是后面必须展开的主题: 既然模型不能独自承担意义与价值,那么在现实制度中,我们究竟应当如何区分回答与判断,如何区分辅助与裁决,如何防止一个会说话的系统在不知不觉间篡夺那些本应由人来承担的文明权力?

(未完待续)